ChatGPT爆火下互聯網科技企業容易遇到哪些輿情風險?

前言

2021年,元宇宙(Metaverse)概念爆火,被視為第三代互聯網形態,各大科技公司紛紛加入到元宇宙探索之中,社交巨頭Facebook甚至將公司名直接改名為Meta。而到了2023年,人工智能聊天機器人chatGPT爆火,又掀起了一場AI模型的大流行,各大科技公司又一窩蜂的扎了進去。

Part1:ChatGPT有多火?

ChatGPT推出后,兩個月內用戶超1億,創下了互聯網最快破億應用的記錄,達到這個成績,TikTok用了9個月,Facebook用了兩年,Instagram用了30個月。

據公開數據顯示,GPT-3發布的兩年多以來,海外風投資本對AIGC的投資增長了 400% 以上。2022年11月到2023年4月之間,國內AIGC融資規模達到22.4億人民幣,相當于過去兩年總計融資額的41.4%。。

在國內,百度、阿里、華為、騰訊、360、商湯、京東、科大訊飛、字節跳動等國內互聯網科技巨頭結合自身業務及戰略布局均已涉足大模型研發,部分已經正式發布和上線產品,部分仍然在研發中。

全球知名AIGC產品 | |

產品 | 所屬公司 |

ChatGPT | OpenAI |

Bing必應(ChatGPT版) | 微軟 |

Bard | |

Character.AI | Character.AI |

RoBERTa、LLaMA(開源) | |

Amazon Titan | Amazon |

Jasper.ai | Jasper |

Copy.ai | ARR |

Claude | Anthropic |

ACT-1 | Adept AI |

Stable Diffusion(開源) | Stability AI |

Hugging Face Transformers(開源) | Hugging Face |

文心一言 | 百度 |

通義千問 | 阿里巴巴 |

盤古Chat(未發布) | 華為 |

360智腦 | 360 |

商量 | 商湯 |

chatJD(未發布) | 京東 |

星火 | 科大訊飛 |

ChatGPT在2022年11月底推出,在2023年2月份,國內關注度飆升,搜索量整體環比增長2880%。 ChatGPT的火熱同時AIGC(利用AI技術生成內容)這一概念也被徹底帶火,成為最熱門的風口之一,剛剛過去的2022年也被形容為AIGC元年,人工智能已經從1.0時代進入2.0時代,相關搜索量整體環比增長832%。

根據識微商情輿情監測系統顯示,近三個月來,ChatGPT相關網絡熱度呈逐漸降低的趨勢,相關信息量394萬。相對來說AIGC的熱度比較平穩,相關信息量109萬。ChatGPT這個產品雖然正在降溫,但AIGC這個產業已經形成一定的認知度。

Part2:ChatGPT類人工智能常見輿情風險類型

不管是人還是物,都逃不過“人紅是非多”的定律,因此ChatGPT這類人工智能的出現后,就爆出各種引發爭議或者負面的事件,這對于所有從事AIGC的公司或者準備進入的公司來說,都需要去關注和思考的問題。

針對目前爆發的一些新聞事件,這里總結了ChatGPT類人工智能常見輿情風險類型:

(1)公司戰略風險

如百度所說的,ChatGPT是人工智能的里程碑和分水嶺,意味著AI發展來到了臨界點——即AI基礎厚實后,AI創新將會越來越細分,在各垂直場景會不斷爆出顛覆性產品,震蕩出空前的行業機會。

在這樣的背景之下,企業想要在下個十年中爭得一席之地,就不得不迎風口而上。當新技術出現并受到社會廣泛關注時,為了避免被視為落后或不創新,科技公司需要跟進研發以保持競爭力。如果競爭對手開始大力投資和開發新技術,那么一個缺乏跟進的公司就會被迅速取代。此外,跟進研發可以提升公司的品牌形象和聲譽,使其更具吸引力和競爭力。

全球許多互聯網公司跟進相關AI模型研究,不管是自行研發還是投資相關公司,也是因為他們希望能夠獲得類似的成功,提高自己在自然語言處理領域的競爭力。

而ChatGPT的誕生對搜索起家的企業影響巨大,ChatGPT可以幫助用戶快速篩選有用的信息,獲得唯一且準確的答案,減少在網頁中翻找的過程,微軟將OpenAI的技術整合到Bing搜索引擎中,引發搜索市場巨震。

Alphabet和百度的核心盈利項目都是廣告業務,網頁瀏覽減少了,也就意味著客戶投放的廣告不會再被用戶看到。外界認為谷歌在搜索市場的霸主地位或將受到威脅。

2023年2月9日,谷歌緊急推出全新AI聊天機器人Bard,結果發布會上Bard首秀翻車。在回答用戶問題時給出了錯誤的答案,加劇了人們對其相關工具尚未準備好集成到搜索引擎中的擔憂。其母公司Alphabet當日股價暴跌8%,市值蒸發約1000億美元。同日,作為ChatGPT的受益方,微軟早盤一度上漲3.4%,市值重回2萬億美元

相對于谷歌的遭遇,百度的運氣似乎好了許多。

2017年,百度提出“All in AI”戰略,李彥宏表示百度是全球為數不多、在這四層進行全棧布局的人工智能公司,從高端芯片昆侖芯,到飛槳深度學習框架,再到文心預訓練大模型,到搜索、智能云、自動駕駛、小度等應用,各個層面都有領先業界的自研技術。類ChatGPT技術對于百度而言既是一次多年押寶換來的厚積薄發的機遇,也是百度不得不交上的一次作業,這份作業如何,靠市場評判。

在2023年2月7日百度官宣“文心一言”當日,其港股股價盤中一度拉高17%。2023年3月16日下午,百度類ChatGPT產品文心一言發布,百度公司創始人、董事長兼CEO李彥宏直言自己測試感覺還是有很多不完美的地方,對標著ChatGPT甚至GPT-4,門檻是很高的。

面對剛剛出世的文心一言,資本市場也頗顯失望,百度港股股價一度下跌10%至120.1港元。過去一夜后,外界的態度卻已開始分化甚至逆轉,17日盤中百度股價漲幅逾15%。作為中國本土首款對標ChatGPT的產品,“文心一言”誕生的意義開始逐漸被資本消化并理解。

從商業角度來看,企業戰略并不會隨意變化,是根據市場發展趨勢來規劃和推出產品和服務的,并不會盲目跟風。即使有成功案例,也存在一定的風險。仿效別人的行動,不一定能夠帶來成功和利潤,因為每個公司的業務模式、資源優勢、所處經濟環境等是不同的。

目前人工智能技術大都集中在互聯網科技行業。許多互聯網公司已經掌握了一定的人工智能技術,并擁有了一定的數據積累(這一點非常重要)。因此,這些公司在未來的發展中需要不斷的創新和升級人工智能技術,以適應快速變化的市場需求。

此外,在同一領域內,如果眾多公司都在追求同一目標,那么競爭將變得更加激烈,難以獲得優勢地位,我們從接連入場的互聯網巨頭們可見這片市場已經“殺”瘋了。

但從技術進步和行業發展的角度來看,跟風現象也有積極意義。通過跟進別人的步伐,可以借鑒別人的經驗和教訓,提高自己的技術水平和創新能力,加快產業發展的步伐。而且,跟風現象也可以促進行業標準的制定和技術交流的加強,從而進一步促進整個行業的發展。

最重要的是,各企業應當根據自身情況做出決策。在跟風的同時,要注重創新和差異化,以保持競爭優勢和長期發展。

(2)公司運營風險

不可否認,AIGC產業前景可觀,有人認為這將是一個萬億級的大市場。但有志于在浪潮中掘金的企業需要提前做好規劃,數據、算力、算法、高精尖人才缺一不可,每一項都耗資巨大,都可能導致經營成本的居高不下,可以預見未來大模型基本會成為大的平臺和科技公司的專屬領地。

每一項新概念、新技術、新商業模式都面臨著市場和周期的篩選過濾。到底怎么用它賺錢,哪種產品和商業模式可能創造最大價值,是每個企業需要就解決的問題。畢竟,先活下來才有后續趕超的可能。

以ChatGPT為例,其花費在算力上的訓練成本介于200萬美元至1200萬美元之間,GPT-3訓練一次的成本約為140萬美元。有機構估算,比如1月份平均每天約有1300萬用戶訪問ChatGPT,那就需要3萬多片英偉達A100GPU芯片,初期投入的成本約為8億美元,每日約5萬美元的電費。再加上相應的技術研發和運維成本、這樣的成本投入對于互聯網巨頭來說壓力都不小。OpenAI 通過 API 出售對大語言模型的訪問權限,推出針對企業的產品和服務。付費的 ChatGPT Plus,訂閱人數超過 200 萬,預計每年為 OpenAI 創造數億美元的收入。

而StockAI,第一批AI繪畫產品之一,成立僅4個月,在2022年底因用戶付費無法覆蓋成本,遺憾宣布關閉平臺、退款。

在國內環境下,需要關注與場景結合,找到投資者和客戶愿意“買單”的方向。比如百度在發布會第二日就宣布,排隊申請百度智能云文心一言企業版API調用服務測試的企業用戶達破7.5萬,與百度智能云基于文心一言展開合作咨詢已達6080條,當天的股價就上漲了。

企業在運營和資金上出現問題可能會導致客戶和投資者對其失去信任,從而影響其聲譽和業務。同時,媒體可能會對其進行曝光,并引起社會輿論關注,進一步加劇企業的輿情風險。Stability AI從暴雷到人士變動就引發各種猜測和媒體關注,讓投資人們望而卻步。

2023年6月初,福布斯網站報道AIGC明星獨角獸Stability AI爆雷,7億融資燒大半還拖欠工資,內部周轉困難、管理混亂等經營問題。6月底,彭博社等媒體報道,研究主管 David Ha 和首席運營官 Ren Ito 從 Stability AI 離職。還有知情人士透露,Stability AI發售了可轉換票據,該公司目前深陷融資困境。這筆可轉換票據交易的融資規模不到2500萬美元。Stability AI發言人表示該公司并沒有在融資方面遇到困難。

(3)虛假信息和謠言的傳播風險

聊天AI語言模型能夠自動生成大量的虛假信息和謠言,快速傳播并在社交媒體上迅速蔓延,給社會帶來嚴重的負面影響。包括以下幾個方面:

l 影響公眾的判斷力和思維能力。虛假信息和謠言可能會誤導公眾的思想,使人們無法準確地了解事實真相,影響公眾的判斷力和思維能力。

l 擾亂正常的社會秩序。虛假信息和謠言可能會引發恐慌、群體事件等,擾亂正常的社會秩序。

l 損害個人的聲譽和財產。虛假信息和謠言可能會導致某些個人或企業的聲譽受損,甚至影響到其財產。

2023年3月份,一女子在地鐵的照片被人用Ai一鍵脫衣的事件一度沖上了熱搜。事實上,照片的女主角是小紅書的一名博主,而所謂的“裸照”則是她去年7月在平臺分享的一張照片。原圖中她衣著正常,完全沒有任何不妥之處,但卻被有心之人用AI軟件一鍵脫衣,故意全網散播制造黃謠,引發廣大網友一片謾罵聲。

不僅如此,嚴絲合縫的AI合成還引起了恐慌,部分人表示不敢再隨意發自己的照片了,畢竟隨便一張照片在網絡上找到相關AI軟件進行“一鍵轉換”就能毀掉一個人。

為了應對和避免這樣的事情發生,開發者、網絡平臺和監管部門應該采取以下措施:

l 開發更加智能和敏銳的AI算法和技術。這些技術可以幫助平臺快速發現和檢測虛假信息和謠言,并及時進行刪除。

l 提高用戶對虛假信息和謠言的警惕性和辨別能力。平臺可以通過推送一些關于如何辨別虛假信息和謠言的內容,幫助用戶更好地識別和避免被騙。

l 加強相關法規的制定和實施。監管部門可以通過完善相關法規,加大對虛假信息和謠言的處罰力度,從而有效遏制這些不良行為的發生。

雖然聊天AI語言模型的出現為人們的工作、生活提供了便利,但與此同時也需要我們保持警惕,防范虛假信息和謠言的不良影響。

(4)數據隱私風險

AI語言模型需要處理大量的個人信息,包括語音、圖像等,這些數據可能被用于非法目的,并產生不良的影響,例如:

l 用戶隱私泄露:AI語言模型是基于用戶數據訓練的,并且這些數據通常包含敏感信息,例如個人身份信息,醫療記錄等。如果這些數據被泄露,它們可能會被用于惡意目的,比如詐騙、人身攻擊等非法活動,這些行為可能會對個人的尊嚴和權益造成損害。

l 經濟損失:由于數據泄漏造成的負面影響,企業和個人可能會面臨經濟損失。泄露的數據可能包括客戶信息和商業機密等重要信息,這些信息如果被用于不良目的,可能會導致企業的經濟損失。

l 公眾疑慮:如果公眾發現AI語言模型存在數據泄露問題,他們可能會對該技術產生疑慮。這可能會導致公眾對于使用AI技術收到限制或抵觸情緒,進而限制了AI技術的發展。

如何在AI 時代下避免以上的問題?可以做以下措施:

l 加強數據隱私保護:企業和應用程序都應該確保用戶數據的保密性,以此避免數據被泄露。為此,他們應該實施強密碼、認證、授權和加密功能等信息安全措施,并嚴格控制數據訪問權限。

l 減少數據收集量:在訓練AI語言模型時,只需收集必需的數據,即可最大程度減少數據泄漏的風險。企業和應用程序只需要收集他們需要的數據,而不需要采集大量額外的信息。

l 加強對數據處理的標準:數據處理應該依據數據保密等標準進行,以保障數據的安全和隱私。企業和應用程序應該遵循公認的信息處理標準,并確保負責任的數據存儲和傳輸。

l 數據透明度:公司應該透明地告知用戶AI系統如何運作、使用者的數據如何被使用,以及如何收集和清除用戶數據。

l 監管部門應該加大監督力度,并確保企業和應用程序符合相關隱私保護的必要規定。

(5)倫理問題

現在有些聊天AI語言模型推出了AI男友/女友功能,可能存在一些潛在的倫理問題、產生一些社會負面影響。

據全球有超過1000萬Replika注冊用戶的創始人Eugenia Kuyda說,約有40%的人是把AI當作戀人。有一位23歲美國女網紅Caryn Marjorie,用AI分身交1000多男友,實現月入500萬美元。還有海外新聞報道稱,有人已經宣布和AI相愛結婚了,上演人機戀現實版。

俄國作家陀思妥耶夫斯基曾說過,“愛具體的人,不要愛抽象的人,要愛生活,不要愛生活的意義。”如果人們變得過度沉迷于與AI伴侶交互,會導致現實人際交流和社交技能的退化,對現實中的親密關系失去興趣。

此外,若通過AI生成的對象代替了現實中的伴侶,可能會導致結婚率降低等社會問題。同時,還可能出現AI對人類的不適當行為的情況,例如性騷擾、壓迫性行為等等。另外,本質上,將AI作為伴侶的實踐可能會維持和加劇社會中性別歧視和對象化的問題。

為了防止這些負面影響,可以通過制定合適的法律法規和監管機制來對這些技術進行限制和監管;同時,在教育中也要加強對擬人化技術和倫理問題的教育。最重要的是,應該讓人們認清事物的本質,理性對待AI技術,避免過度依賴AI技術。

(6)版權問題

ChatGPT這類生成式人工智能需要大量的數據材料進行訓練學習,其訓練過程中抓取的數據也會有侵權的風險。

據報道,兩名作家在美國舊金山聯邦法院起訴OpenAI,他們認為ChatGPT未經許可從大量圖書中復制提取數據,侵犯了作者的版權。源代碼所有者將矛頭指向OpenAI和微軟旗下GitHub,視覺藝術家起訴Stability AI、Midjourney和DeviantArt等AI工具。被告則認為,系統合理使用了有著作權的作品。

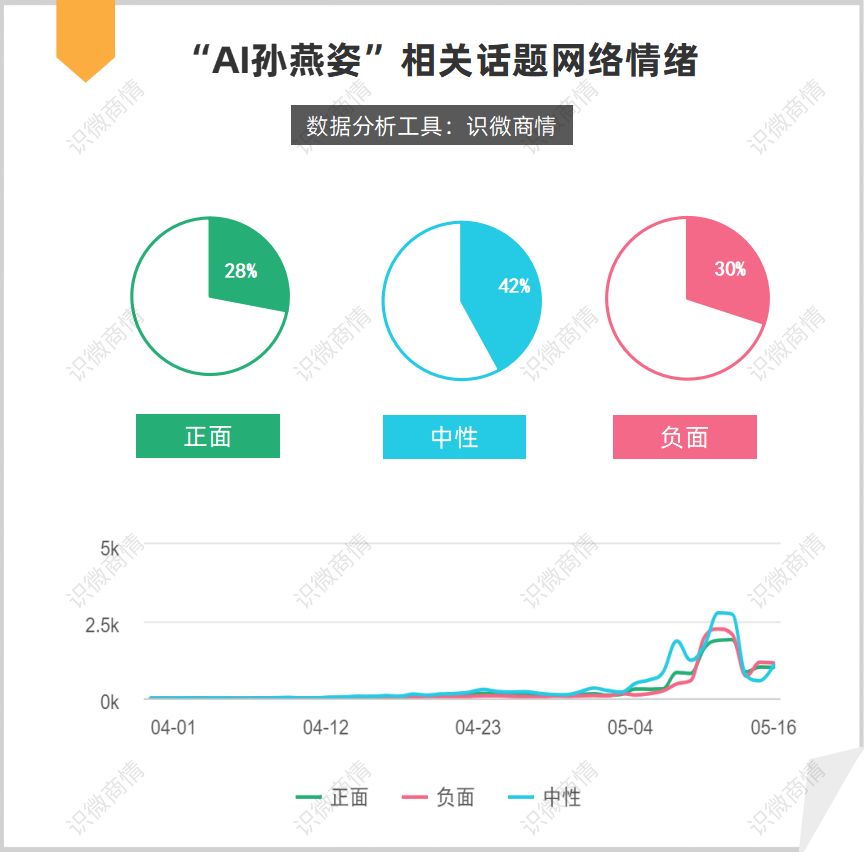

不僅是聊天AI,在其他AI模型也是版權侵權重災區。比如今年5月份,視頻網站嗶哩嗶哩的二創區AI孫燕姿爆火。在AI技術的一番運轉下,孫燕姿不但“被翻唱”了《發如雪》《半島鐵盒》《水星記》《套馬桿》等熱曲,還與周杰倫、林俊杰等歌手跨時空地“被合唱”了。

面對這波熱潮,網友們褒貶不一。相關話題下,中性情緒表達占42%,負面及正面另各占30%、28%。

AI音色轉換技術Sovits開發者Rcell發布緊急公告稱,由于最近在B站等平臺出現了眾多使用svc (包括Sovits,diff-svc等)和未授權數據集訓練明星、知名藝人、知名公眾人物的模型,且這些作品在平臺流量高,并且引起敏感性話題。為避免引起更嚴重的法律問題,Sovits倉庫已經刪除。同時,項目開發者還強調,“這個項目是為了讓開發者最喜歡的動畫角色唱歌而開發的,任何涉及真人的東西都與開發者的意圖背道而馳。”

被AI復刻的歌手孫燕姿本人回應:“人類無法超越它已指日可待。無論你多么小眾、多么反常或者精神多么錯亂,都可能有專門為你創建的獨特內容。你并不特別,你已經是可預測的,而且不幸你也是可定制的。”

人民網評:《AI歌手需系好法律這個第一紐扣》“AI歌手”是新技術在音樂領域的拓展,是一種值得肯定的事情。然而,創新精神還需要考量產品市場化中如何維護原作者權益。要想讓這種技術更加成熟,更有利于歌曲的傳播,并且讓老百姓獲益,就需要各方高度重視法律問題,讓各方在互惠互利中同向而行。

(7)政策法律問題

ChatGPT為代表的AI技術雖然給許多人和公司帶來了生產力的提升,但所帶來的隱私、倫理、虛假信息等方面問題也越來愈多,必須建立嚴格的法律制度來打擊。目前互聯網相關法律法規在不斷完善,尤其是針對剛爆發的生成式人工智能。

《網絡安全法》第二十七條的規定當中,特別強調,明知他人實施危害網絡安全活動的,不能夠為他提供技術支持,如果情節嚴重,還會構成幫助信息網絡犯罪活動罪等刑事犯罪。這也明確了技術制造者的責任。

2023年1月10日開始施行的《互聯網信息服務深度合成管理規定》中也提出,要對深度合成技術應用提出規范,明確了算法備案、安全評估、顯著標識等強制性要求及適用情形,如規定深度合成服務提供者和技術支持者若生成或編輯生物識別信息,必須進行算法安全評估。深度合成技術,是指利用深度學習、虛擬現實等生成合成類算法制作文本、圖像、音頻、視頻、虛擬場景等網絡信息的技術。其中也包括人臉生成、人臉替換、人物屬性編輯、人臉操控、姿態操控等生成或者編輯圖像、視頻內容中生物特征的技術,圖像生成、圖像增強、圖像修復等生成或者編輯圖像、視頻內容中非生物特征的技術,三維重建、數字仿真等生成或者編輯數字人物、虛擬場景的技術等。

2023年4月11日,國家網信辦就《生成式人工智能服務管理辦法(征求意見稿)》公開征求意見,專門對AIGC產品提供者的責任邊界提出要求,強調要尊重知識產權、商業道德,不得利用算法、數據、平臺等優勢實施不公平競爭;要從數據源開始確保“生成內容”的真實準確,要對生成式人工智能產品的預訓練數據、優化訓練數據來源的合法性負責。

這意味著,生成式人工智能即將告別野蠻生長期,走入正軌。而企業最好提前配備AI專家和技術人員,確保系統的監管合規性,避免成為達摩克利斯之劍下的首殺。

AI企業輿情監測

人工智能行業現處于高速發展階段,從業者及相關企業有必要洞悉行業動態,監測您所處行業相關的產業動態、法律法規、行業政策等,囊括企業所關注的行業招標信息、用戶需求、法律風險、供應鏈信息等內容,幫助企業實現業務創新,拓展銷售機會。

其次是了解競爭對手,在網絡平臺的輿情動態,包括負面聲量、品牌宣傳、新品發布、公關活動等,洞悉競爭對手的商業戰略變化,為贏得和保持競爭優勢提供決策支持。

識微商情輿情監測系統覆蓋新聞媒體、社交媒體、主流門戶網站、論壇、博客、微信公眾號等多個平臺,7×24h實時監測、提前預警,幫助企業快速了解AI行業動態、競品動態,為企業的戰略決策提供參考。

【識微商情系統】支持企業輿情全網監測、負面預警及分析報告等功能

【文章聲明】識微科技網倡導尊重與保護知識產權。本網站文章發布目的在于分享輿情知識。部分內容僅是發稿人為完善客觀信息整理參考,不代表發稿人的觀點。未經許可,不得復制、轉載、或以其他方式使用本網站的內容。如發現本網站文章、圖片等存在版權問題,請及時聯系并發郵件至zhangming@civiw.com,電話:4008299196,我們會在第一時間刪除或處理相關內容。

- 0高管輿情:輿論如何看待網易游戲高管貪腐事件

- 1日化輿情:輿論如何看待蜂花廣告被質疑丑化女性事件

- 2食品輿情:輿論如何看待良品鋪子疑造假被調查事件

- 3網紅輿情:輿論如何看待“瑞士卷怎么分”被疑擺拍事件

- 4職場輿情:輿論如何看待絲芭傳媒鞠婧祎互訴事件

- 5互聯網輿情:輿論如何看待B站回應疑有員工操縱抽獎概率事件

- 6直播輿情:輿論如何看待聽泉賞寶稱病了準備先沉淀

- 7食品輿情:輿論如何看待網曝塔斯汀漢堡吃出生肉?

- 8網紅輿情:輿論如何看待山取團隊疑似擺拍事件

- 9電商輿情:輿論如何看待京東邀請楊笠參加活動爭議事件

- 10車企輿情:輿論如何看待邁巴赫漏水事件?

- 11直播輿情:東北雨姐虛假宣傳紅薯粉事件始末及輿情分析

- 12酒店輿情:石家莊民宿隱藏攝像頭事件

- 13互聯網輿情:輿論如何看待淘寶支持微信支付

- 14游戲輿情:輿論如何看待戀與深空回應抄襲事件

- 營銷案例:瑞幸聯名黑神話悟空,激發男性購買力

- 游戲輿情:哈圈大戰乙游事件完整吃瓜版及輿情分析

- 食安輿情:輿論如何看待黑心枸杞被曝光

- 餐飲輿情:瑞幸咖啡為寫錯易烊千璽名字道歉

- 直播輿情:輿論如何看待董宇輝帶貨月餅疑有質量問題

- 電商輿情:輿論如何看待京東邀請楊笠參加活動爭議事件

- 湖南中小學輿情監測應對方案??

- 食品安全負面線索排查怎么做?網絡輿情監測法

- 國內輿情監測系統排名(最新版)?

- 食品輿情監測解決方案??

- 汽車輿情監測解決方案??

- 網絡輿情監測系統功能介紹(全面版)

- 輿情監測系統價格及報價方案??

- 互聯網輿情:輿論如何看待B站回應疑有員工操縱抽獎概率事件

- 日化輿情:輿論如何看待蜂花廣告被質疑丑化女性事件

- 商業查詢平臺推薦-識微商情

- 輿情搜索引擎是什么?有哪些?

- 梅州輿情管理辦法

- 輿情監測RPA系統軟件平臺??

- 輿情軟件排行榜前十名的是哪幾個?

- 網絡輿情監測平臺哪個好用?

- 展會相關情報怎么收集?展會輿情監測辦法

- 梅州輿情動態怎么獲取?

- 停車收費網絡輿情管理分析

- voc客戶之聲是什么意思?相關工具推薦

- 2025年315輿情風險排查方案

- 公司負面消息監控系統??

- 梅州輿情監測工作要怎么做?

- 2025年315曝光輿情防御方案

- 重大活動輿情風險及管控